Stability AI发布Stable Code 3B模型

今天,我们宣布 2024 年发布第一个大型语言模型:Stable Code 3B。这个新的 LLM 是我们之前发布的 Stable Code Alpha 3B 的后续版本,也是第一个主要的 Stable Code 版本,提供了一个新的最先进的模型,专为代码完成而设计,具有多种附加功能。

Stable Code 3B模型性能和特点:

1、体积小效率高: 与 CodeLLaMA 7b 相比,Stable Code 3B 体积缩小了 60%,同时跨编程语言具有相似的高级性能。基于我们预先使用 4 万亿个自然语言数据进行训练的 Stable LM 3B 基础模型,Stable Code 进一步接受了软件工程特定数据(包括代码)的训练。该模型的紧凑尺寸使其可以在现代笔记本电脑的边缘实时私下运行,即使是那些没有专用 GPU 的笔记本电脑。

2、普通电脑即可运行: 由于其紧凑的模型尺寸,Stable Code 3B可以在现代笔记本电脑上实时运行,甚至包括那些没有专用GPU的型号。

3、100k上下文大小: Stable Code 3B支持更大的上下文大小,能处理长达100,000个令牌的序列,从而提供更丰富、更精确的编码补全。Stable Code 3B 跨多种语言提供更多功能和显着更好的性能,并具有额外的优势,例如支持中间填充功能 (FIM) 和扩展的上下文大小。 Stable Code 作为基础,在最多 16,384 个标记的序列上进行训练,但遵循与 CodeLlama 类似的方法,实施旋转嵌入,可选择允许修改最多 1,000,000 个旋转基础,进一步将模型的上下文长度扩展至 100k 个标记。

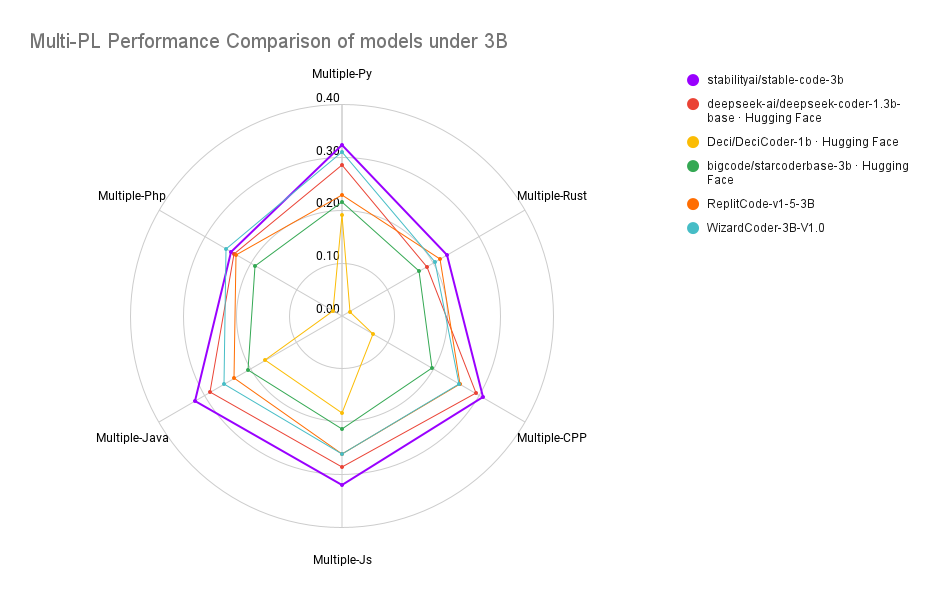

4、18种编程语言的训练: Stable Code 经过 18 种编程语言(根据 2023 年 StackOverflow 开发者调查选择)进行训练,并在测试的多种编程语言的 MultiPL-E 指标上展示了最先进的性能(与类似大小的模型相比)。

Stable Code 3B模型包含在我们新的 Stability ai 会员资格中。请访问我们的会员页面,利用我们的商业核心模型产品,包括 SDXL Turbo 和稳定视频扩散。

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统