FunAudioLLM:阿里巴巴语音AI突破

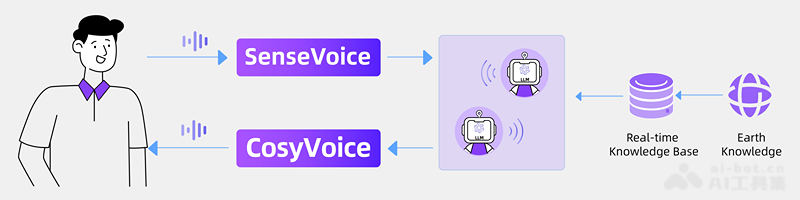

FunAudioLLM是阿里巴巴开发的一套语音处理模型,旨在改善人类与大型语言模型之间的语音交互。它由两个主要模型组成:SenseVoice 和 CosyVoice。

SenseVoice :一种语音识别模型,可以识别多种语言的语音,识别说话者的情绪,并检测音频中的特殊事件(例如音乐、笑声等)。它可以快速准确地转录语音内容。

CosyVoice :语音生成模式,该模型主要生成自然且情感丰富的语音。它可以模仿不同的说话者,甚至可以通过几秒钟的音频样本克隆一个人的声音。

通过SenseVoice和CosyVoice的结合,FunAudioLLM提供了全面的语音理解和生成能力,使得人与大型语言模型之间的语音交互更加自然和丰富。

SenseVoice 和 CosyVoice 的主要特性:

SenseVoice专注于多语言语音识别、情感识别和音频事件检测,提供高精度、低延迟的语音处理能力。 CosyVoice专注于自然语音生成和控制,支持多种语言、音色、说话风格的生成,可以实现零样本学习和细粒度的语音控制。两者的结合使得FunAudioLLM能够在多种应用场景下提供出色的语音交互体验。

SenseVoice 主要特性

1.多语言语音识别

SenseVoice-Small :支持中文、英语、粤语、日语、韩语五种语言。它采用非自回归端到端架构,识别延迟极低。它比 Whisper-small 快 5 倍,比 Whisper-large 快 15 倍。

SenseVoice-Large :高精度语音识别,支持 50 多种语言。

2. 情绪识别

通过检测言语的音高、节奏、语调变化来识别言语中的情绪,如快乐、悲伤、愤怒等。

3. 音频事件检测

检测语音中的特殊事件,例如音乐、笑声、掌声等,并预测事件的开始和结束时间。

SenseVoice-Small可以检测各种人机交互事件,如背景音乐、掌声、笑声、哭声、咳嗽、打喷嚏等。

4. 语言识别

能够识别说话者使用的语言,以确保语音识别和上下文理解的准确性。

5. 逆向文本标准化(ITN)

提供标点和格式化的转录结果,以提高转录文本的可读性和准确性。

FunAudioLLM的主要特点:

多语言语音识别:超过40万小时的训练数据,识别性能优于Whisper模型。

高效推理:SenseVoice-Small模型采用非自回归端到端框架,推理延迟极低。处理 10 秒的音频仅需 70 毫秒,比 Whisper-Large 快 15 倍。

情绪识别:在多个测试数据集上,达到了目前最好的情绪识别模型的结果。

事件检测:支持多种常见的音频事件检测。

便捷的微调:提供便捷的微调脚本和策略,用户可以根据业务场景轻松解决长尾样本问题。

服务部署:提供服务部署管道,支持多个并发请求,客户端语言包括Python、C++、HTML、Java、C#等。

CosyVoice 的主要特点:

1.语音生成

支持多语言语音生成,包括中文、英语、粤语、日语、韩语。

能够生成自然且情感丰富的语音,支持不同的说话风格和情感表达。

2.多样化的语音控制

音色控制:可以精确控制生成语音的音色,使其与特定说话者的声音相匹配。

说话风格控制:通过文本命令控制声音的说话风格,如情绪、语速、音调等。

3. 零样本学习

只需几秒钟的音频样本即可克隆语音,无需额外的训练数据。

支持跨语言语音克隆,让您用一种语言使用另一种语言的声音说话。

4. 副语言特征的细粒度控制

支持插入笑声、呼吸、语气词等细微的语音特征,使生成的语音更加自然生动。

文本命令控制:通过文本命令可以精确控制说话者的身份、情绪、说话风格。

5.多角色对话

它可以生成多字符会话语音,适用于互动播客、情感聊天等场景。

项目地址:https://github.com/FunAudioLLM

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 图生视频

图生视频 文生视频

文生视频 AI源码系统

AI源码系统