CNBC:中国人工智能公司DeepSeek引发硅谷恐慌

CNBC 花了足足40分钟来报道DeepSeek,观看此视频。

标题:中国新的人工智能模型 DeepSeek 如何威胁美国的主导地位

全文翻译:

中国一家鲜为人知的人工智能DeepSeek发布的人工智能模型在整个硅谷引发了恐慌,该模型的性能超越了美国最好的模型,尽管其制造成本更低,芯片性能也较差。

DeepSeek(该实验室的名称)于 12 月底推出了一个免费、开源的大型语言模型,据称该模型仅用了两个月的时间,花费不到 600 万美元就建成了,使用的是 Nvidia 的功能较低的 H800 芯片。

这些新进展敲响了人们的警钟:美国在人工智能领域的全球领先地位是否正在萎缩,并让人对大型科技公司在构建人工智能模型和数据中心方面的巨额支出提出质疑。

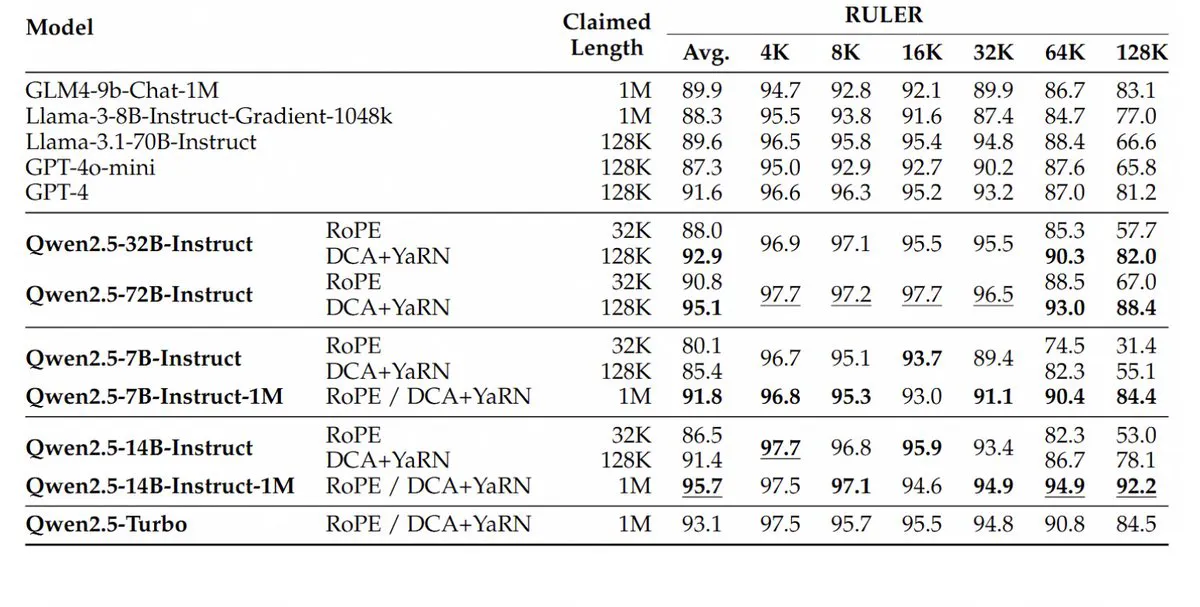

在一组第三方基准测试中,DeepSeek 的模型表现优于Meta的 Llama 3.1、Openai 的 GPT-4o 和 Anthropic 的 Claude Sonnet 3.5 的准确度范围从复杂问题的解决到数学和编码。

DeepSeek周一发布了R1,这是一种推理模型,在许多第三方测试中也优于Openai的最新O1。

微软首席执行官萨蒂亚·纳德拉(Satya Nadella)在世界上说:“看到DeepSeek的新模型,这两者都非常有效地完成了进行这种推理时间计算的开源模型,而且非常有效,”周三在瑞士达沃斯举行的经济论坛。 “我们应该非常非常重视从中国的发展。”

由于美国政府对中国强加的严格半导体限制,从而使该国无法进口最强大的芯片,例如Nvidia的H100。表明DeepSeek要么找到了一种解决规则的方法,要么解决华盛顿出口控制障碍。

Benchmark 普通合伙人 Chetan Puttagunta 表示:“他们可以采用一个非常好的大型模型,并使用一种称为蒸馏的过程。” “基本上,你使用一个非常大的模型来帮助你的小模型在你希望它变得聪明的事情上变得聪明。这实际上非常划算。”

关于DeepSeek及其创始人梁文峰,人们知之甚少。据媒体报道,DeepSeek 诞生于一家名为 High-Flyer Quant 的中国对冲基金,该基金管理着约 80 亿美元的资产。

但是DeepSeek并不是唯一一家闯入的中国公司。

AI研究员Kai-Fu Lee表示,他的创业公司01.AI仅使用300万美元培训。 Tiktok母公司周三发布了对其模型的更新,该更新声称在关键基准测试中表现优于OpenAI的O1。

“需求是创新之母,”困惑首席执行官Aravind Srinivas说。 “因为他们不得不想办法找到替代方案,最终他们实际上开发出了更加高效的技术。”

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统