什么是大模型的蒸馏(distillation),DeepSeek遭遇的“模型蒸馏”指控是怎么回事?

DeepSeek是一家新兴的人工智能公司,最近因被指控使用Openai的技术进行模型蒸馏而引发大量关注。OpenAI声称,DeepSeek可能通过蒸馏技术提取了其模型的知识,从而开发出竞争对手的产品。

什么是大模型的蒸馏(Distillation)?

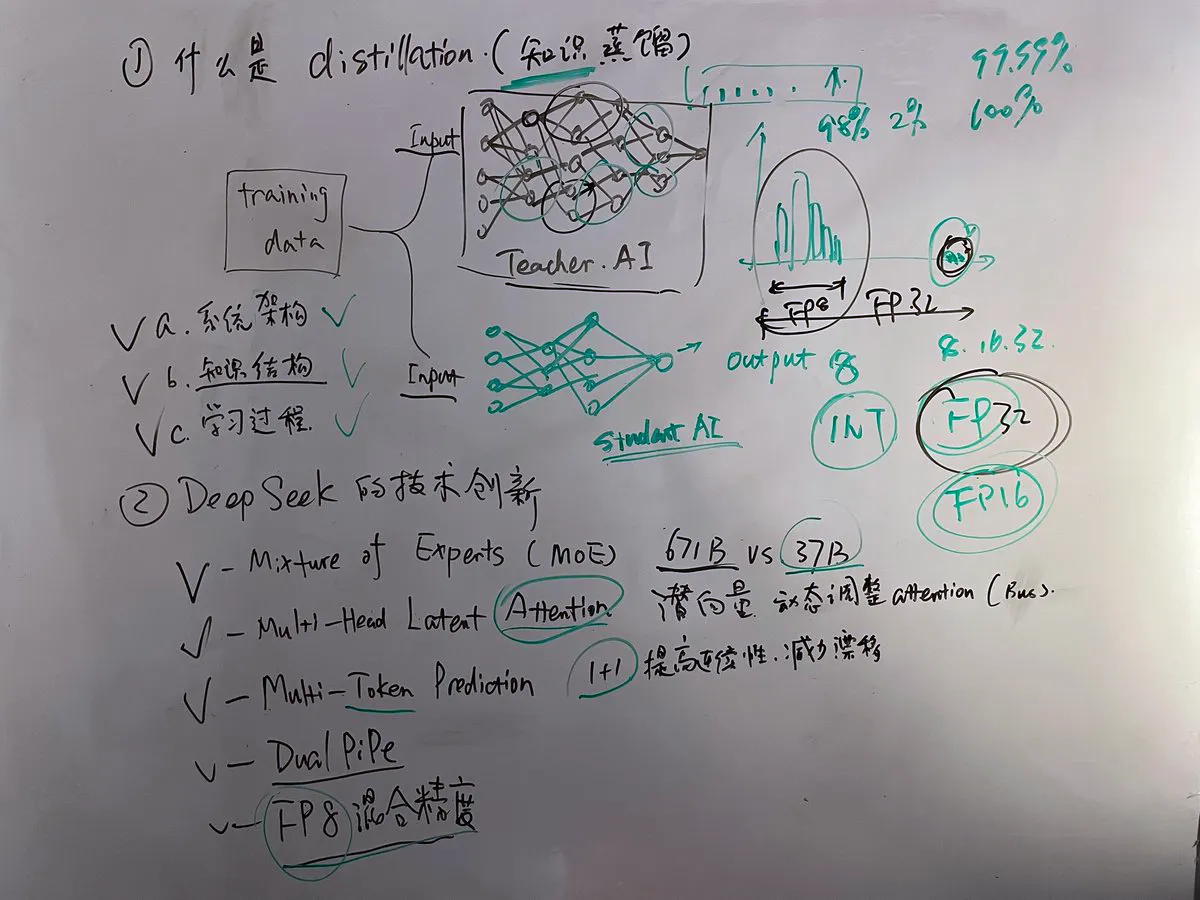

大模型的蒸馏是一种模型压缩技术,旨在将一个大型、复杂的模型(称为教师模型)的知识转移到一个较小、更高效的模型(称为学生模型)中。这一过程通过训练学生模型,使其能够模仿教师模型的输出,从而在保持性能的同时减少计算资源的消耗。

这一概念由Hinton等人在2015年提出,常用于模型压缩、加速推理和降低部署成本,同时尽量保留原模型的性能。蒸馏技术在深度学习中被广泛应用,尤其是在自然语言处理和计算机视觉等领域。

下面用一张youtube“Jeff科技视角”Jeff Li的思维导图体会一下。Jeff Li老师在《第379期:大模型的 蒸馏 (Distillation)及 DeepSeek 遭遇的指控》视频中讲得非常详细。

大模型的蒸馏实施方式:

软标签(Soft Labels): 使用教师模型生成的概率分布而不是硬标签来进行训练。

隐藏激活(Hidden Activations): 将教师模型的部分中间层输出作为辅助信号给学生模型。

注意力权重(Attention Weights): 如果涉及到序列模型,也可以迁移注意机制的相关信息

DeepSeek 遭遇的“模型蒸馏”指控

起因背景:

DeepSeek 是一家初创企业, 提供了自己的大语言模型产品。

DeepSeek的低成本模型开发、开源、免费策略可能威胁到OpenAI 和 Anthropic等公司的市场地位,导致竞争对手对其展开了批评,认为 DeepSeek 不正当使用他们的技术和数据。

关键点:

OpenAI 的立场

指责 DeepSeek 抓取并使用了未经许可的数据来训练自己的模型。

自身存在的问题:OpenAI 自己也被指摘曾非法抓取互联网上的数据来训练其模型,尤其是受版权保护的文章作品。此外,OpenAI 曾因为类似行为遭到《纽约时报》等出版方的法律诉讼。

Anthropic 的观点

反驳严重性: Anthropic 认为 DeepSeek 并没有达到对其产品的真正威胁的程度,称其技术水平相当于几个月之前的版本而已。

微软的态度

微软在其Azure AI和GitHub平台上线了 DeepSeek 模型,显示出某种形式的支持态度,这也引发了关于利益冲突的讨论。

模型蒸馏的具体争议

合法性和规范性:模型蒸馏是一项常见的技术实践,但在实际操作中有严格的规则约束。特别是针对商业用途和技术共享协议的规定,各家公司有不同的解读和执行力度。

如何界定 "未经授权的方式" 获取数据?

是否允许使用某些 API 输出的数据来训练新的竞争性的模型?

证据和支持材料:目前双方都没有完全公开详细的证据支持各自的主张,这增加了事件的复杂性和不确定性。

行业反应和社会舆论

社区内外对此事的看法不一,有人认为这是市场竞争的一部分表现;但也有很多声音关注此事背后的伦理和法律规定是否得到了充分尊重。

DeepSeek 遭遇的 “模型蒸馏” 控诉反映了当前 AI 行业中存在的激烈竞争态势以及围绕着数据使用权、技术创新边界等方面的法规模糊地带带来的挑战。

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统