阿里开源了其最新推理模型:QwQ-32B,可媲美DeepSeek-R1

2025年3月6日凌晨,阿里巴巴正式对外发布并开源了他们最新的推理模型——通义千问QwQ - 32B。

通义千问QwQ - 32B是用大规模强化学习训练出来的。和以往的预训练、后训练方法不一样,强化学习能让模型在和环境互动的过程中去学习知识。就因为这样,它在数学推理、编程还有通用能力这些方面都特别出色,推理能力也能得到更有效的提升。

另外,这个模型里面还加入了和Agent有关的能力。有了这个能力,模型在使用工具的时候,就能够进行批判性思考,还能根据环境给出的反馈,随时调整推理的过程 。

通义千问QwQ-32B模型概述

通义千问QwQ - 32B是一款推理模型,有320亿个参数。虽然它的参数量比DeepSeek - R1(有6710亿参数,其中370亿被激活)少很多,但性能却能和DeepSeek - R1满血版相媲美。

这个模型采用Apache 2.0开源协议,用户能免费下载,还能用于商业用途。模型开源平台有两个,分别是Hugging Face(https://huggingface.co/Qwen/QwQ - 32B )和ModelScope(https://modelscope.cn/models/Qwen/QwQ - 32B )。

通义千问QwQ-32B模型性能

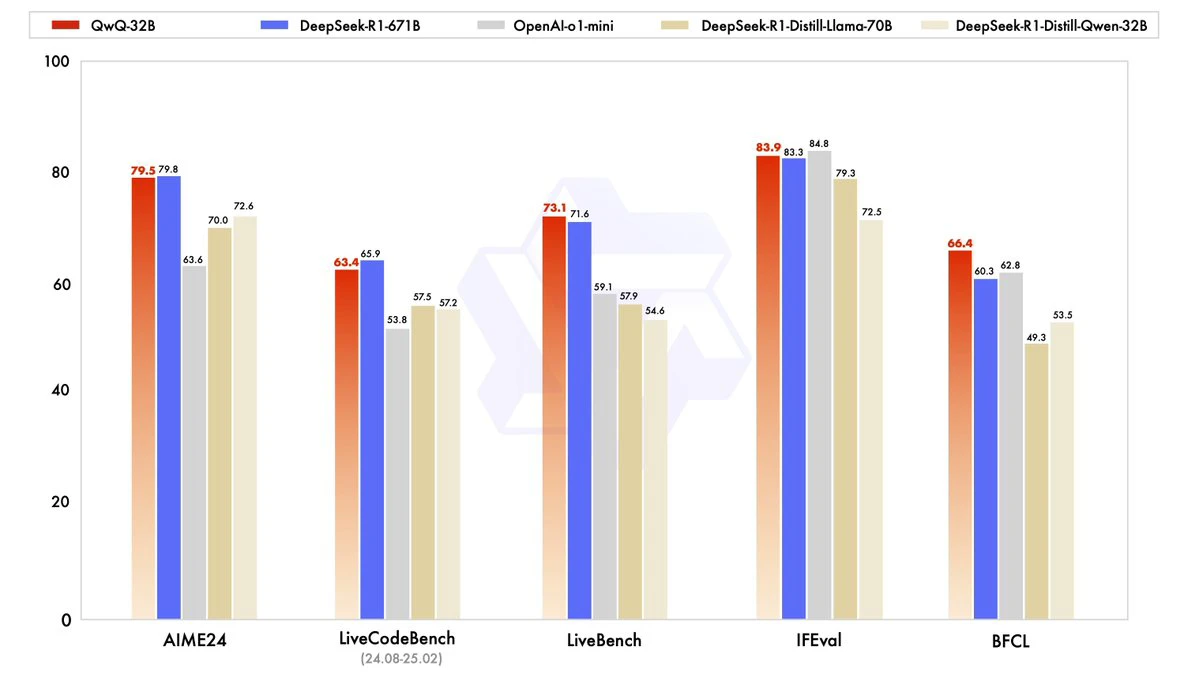

性能表现突出:在数学推理、编程以及通用能力方面,QwQ - 32B都相当厉害。在aiME24评测集和LiveCodeBench测试里,它的表现和DeepSeek - R1差不多,比其他同尺寸的模型都要好。

强化学习与智能体助力:QwQ - 32B通过大规模强化学习,推理能力有了很大提升,能够深入思考和处理复杂问题。而且模型里集成了智能体能力,在使用工具的时候,它能进行批判性思考,还会根据环境反馈来调整推理过程。

多领域都能适应:QwQ - 32B在数学、编程和通用任务处理上表现都很出色,还支持多模态任务,像语音转写、图像识别这些都不在话下。在LiveBench、IFEval和BFCL等基准测试中,它的得分超过了DeepSeek - R1 。另外,它对硬件资源需求不高,消费级显卡就能实现本地部署,很适合硬件资源有限的应用场景。

通义千问QwQ-32B模型应用

数学与逻辑推理:在数学推理任务,比如AIME24里,QwQ - 32B成绩优异,在教育和科研领域都能派上用场。

编程与代码生成:在LiveCodeBench测试中,它能生成高质量的代码,适合软件开发和编程教育工作。

通用任务处理:在指令遵循(IFEval)、多模态任务处理等方面,QwQ - 32B表现卓越,能应对多种通用任务。

智能体相关任务:因为它支持智能体能力,能进行动态决策和适应环境,所以适用于复杂任务的自动化处理 。

HF:https://huggingface.co/Qwen/QwQ-32B

模型:https://modelscope.cn/models/Qwen/QwQ-32B

演示:https://huggingface.co/spaces/Qwen/QwQ-32B-Demo

聊天:https://chat.qwen.ai

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统