Step-Video-TI2V:阶跃星辰开源的一款AI文生视频和图生视频模型

Step-Video-TI2V是什么

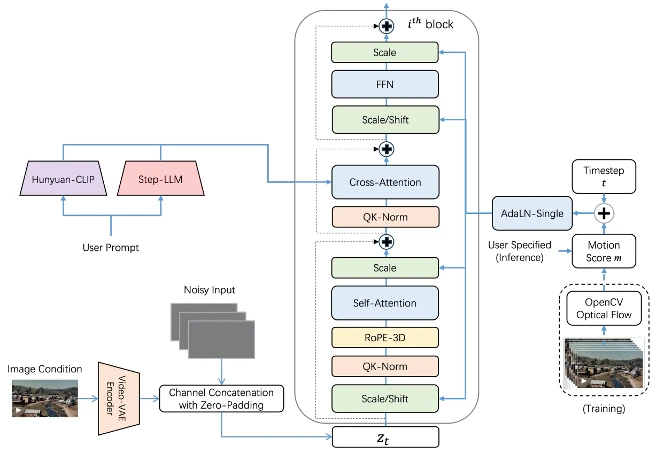

Step-Video-TI2V 是由阶跃星辰团队开源的一款基于文本驱动的ai图生视频模型,可以根据用户输入的文本提示和图像生成高质量的视频。它在动漫风格视频生成方面表现出色,支持运动控制、多语言输入和多种视频格式输出。

Step-Video-TI2V功能

文本驱动的图生视频:根据用户提供的文本提示和输入图像,生成与文本和图像内容高度一致的视频。

运动控制:用户可以指定不同的运动级别,精确控制视频的动态幅度,平衡动态效果和稳定性。

高质量视频输出:能够生成 102 帧、5 秒、540P 分辨率的视频,支持多种视频宽高比(横屏、竖屏和正方形)。

多语言支持:支持中英文输入,方便不同语言背景的用户使用。

指令遵循与内容一致性:在指令遵循、主体和背景一致性以及物理规律遵循等方面表现出色,生成的视频内容符合用户的期望。

基准测试支持:开发了 Step-Video-TI2V-eval 基准数据集,包含 178 个真实世界的提示-图像对和 120 个动漫风格的提示-图像对,用于评估模型性能。

Step-Video-TI2V应用

内容创作:为视频创作者提供灵感和素材,快速生成视频内容,节省时间和精力。

动漫制作:在动漫风格视频生成方面表现出色,可用于动漫角色的动作展示、场景动画等。

广告与营销:生成吸引人的视频广告,展示产品或服务的特点和优势。

教育与培训:制作教育视频,帮助学生更好地理解和记忆知识。

娱乐与社交媒体:为用户提供有趣的视频生成体验,分享到社交媒体上,增加互动性和趣味性。

Step-Video-TI2V安装与使用

安装

1. 环境要求:需要 Python 3.8 及以上版本,以及 CUDA 11.3 及以上版本(用于 GPU 加速)。

2. 安装依赖:通过以下命令安装所需的 Python 包:

pip install -r requirements.txt

3. 下载模型:从 Hugging Face 或 Modelscope 下载模型文件,并将其放置在指定目录下。

使用

1. 准备输入数据:准备一张输入图像和一个文本提示,确保文本提示与输入图像内容相关。

2. 运行代码:使用以下命令运行模型生成视频:

python generate_video.py --image_path --text_prompt "" --output_path

3. 调整参数:根据需要调整运动控制参数(如运动幅度)和其他生成参数,以获得理想的视频效果。

相关链接

GitHub 代码仓库:https://github.com/stepfun-ai/Step-Video-TI2V

Hugging Face 模型页面:https://huggingface.co/stepfun-ai/stepvideo-t2v

Modelscope 模型页面:https://modelscope.cn/models/stepfun-ai/stepvideo-ti2v

Github-ComfyUI:https://github.com/stepfun-ai/ComfyUI-StepVideo

论文:https://arxiv.org/abs/2503.08334

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统