QVQ-Max:阿里推出的视觉推理模型,能够理解图片和视频中的内容

QVQ-Max是什么?

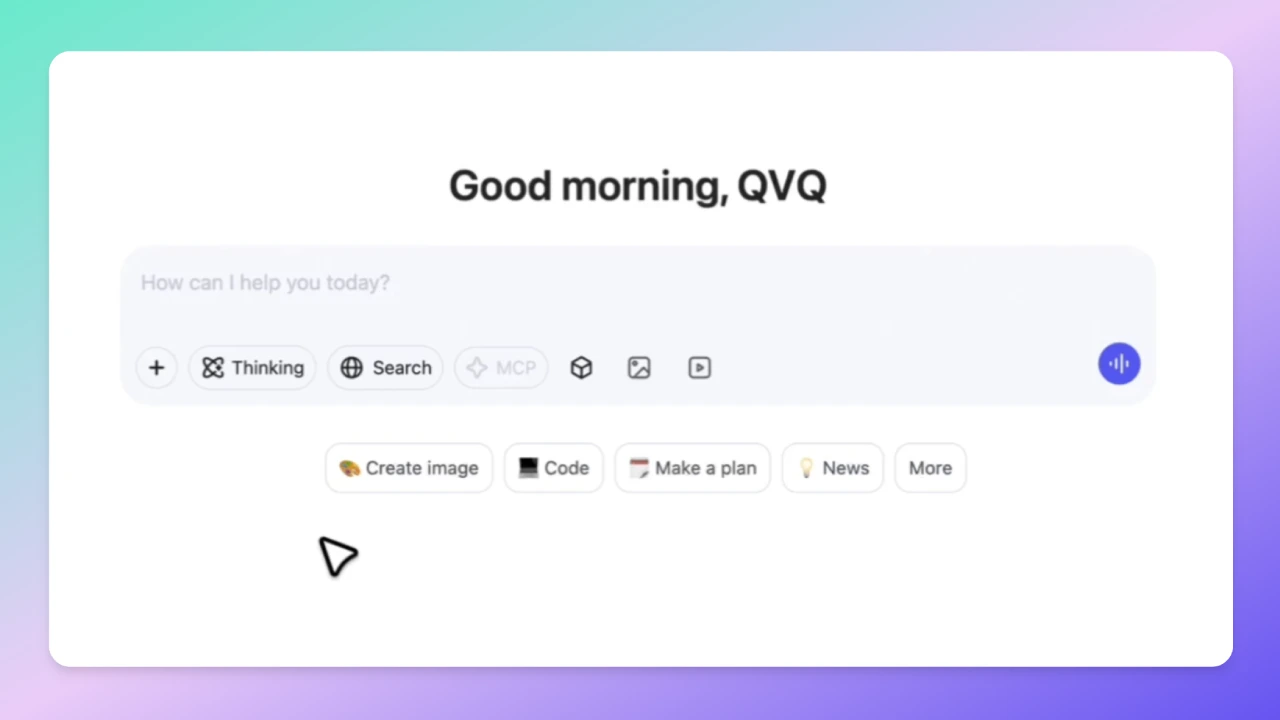

QVQ-Max是一款视觉推理模型,具备理解图片与视频内容的能力,能依据相关信息展开分析、推理,并提供解决方案。QVQ-Max模型在多个领域都有出色表现,像数学题解答、生活问题处理、编程辅助以及艺术创作等方面。

设计初衷

传统ai模型大多依靠文字输入,然而现实里很多信息是以图片、图表或者视频形式呈现的。QVQ-Max旨在打造一个既善于捕捉视觉信息,又具备快速分析能力的助手,助力用户解决各类实际问题。

QVQ-Max核心能力

细致观察:QVQ-Max 能快速识别图片中的关键元素,无论是复杂的图表还是日常照片,它都能捕捉到细节。

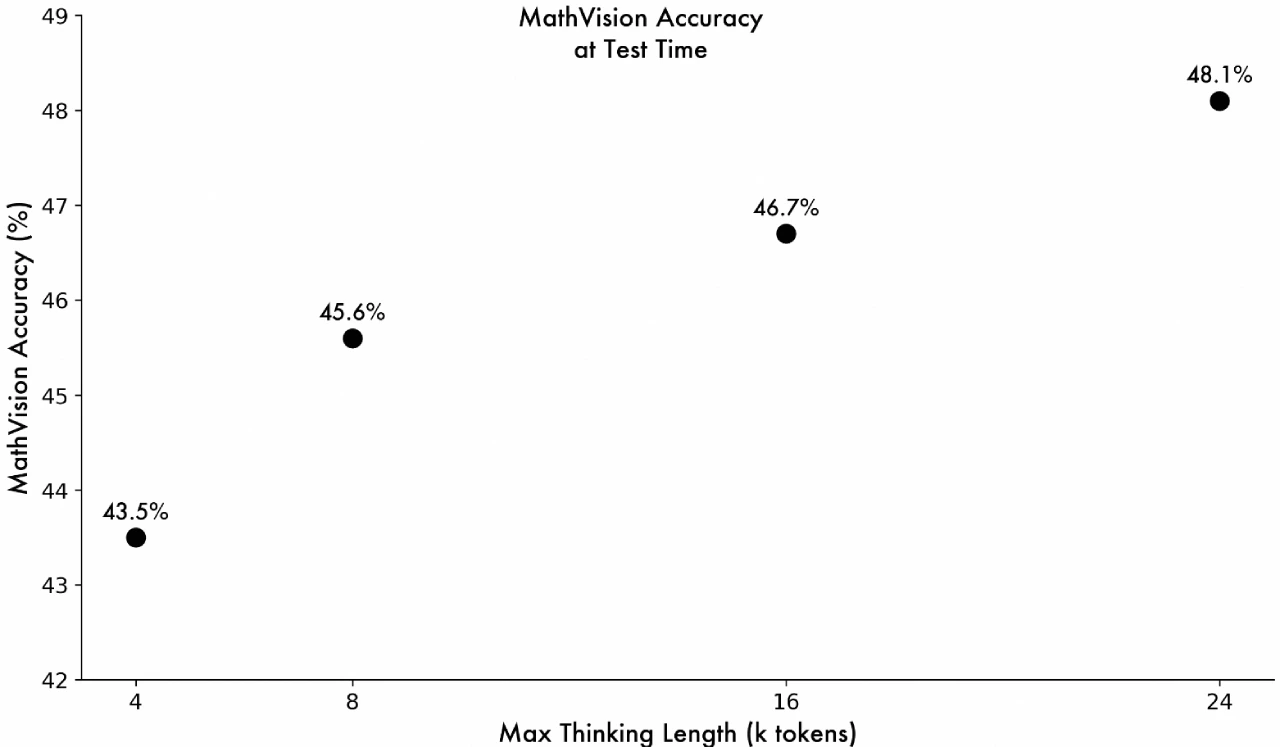

深入推理:模型不仅识别内容,还能结合背景知识进行推理。例如,它可以解析几何题中的图形并推导出答案。

灵活应用:除了分析和推理,QVQ-Max 还可以用于创作,比如设计插画、生成短视频脚本,甚至根据用户需求创作角色扮演内容。

QVQ-Max应用场景

职场应用:辅助完成数据分析、信息整理以及编程等工作。

学习辅助:助力解答数学、物理等学科难题,特别是配有图表的题目。

生活协助:依据衣柜照片提供穿搭建议,或者根据食谱图片指导烹饪操作。

QVQ-Max的使用教程

2、选择QWQ-32B模型

3、点输入框的“+”号上传图片或视频。

4、提问图片的内容。

未来发展方向

提升观察能力:借助视觉内容校验技术(如grounding),增强识别精准度。

强化任务处理能力:发展视觉Agent,提高处理多步骤及复杂任务的能力,例如操作手机、电脑或玩游戏等。

优化交互体验:拓展交互模态,涵盖工具校验以及视觉生成等方面。

QVQ-Max作为一款视觉推理模型,潜力巨大。它不仅能识别图片内容,还能结合信息进行分析推理,甚至完成一些创造性任务。尽管目前仅是第一版,但已彰显出很大潜力,未来有望成为实用的视觉Agent,为用户解决实际问题提供有力支持 。

详细介绍:https://qwenlm.github.io/zh/blog/qvq-max-preview/

使用地址:https://chat.qwen.ai/

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统