Ghibli-Diffusion:吉卜力工作室风格的AI图像生成模型

Ghibli-Diffusion是什么?

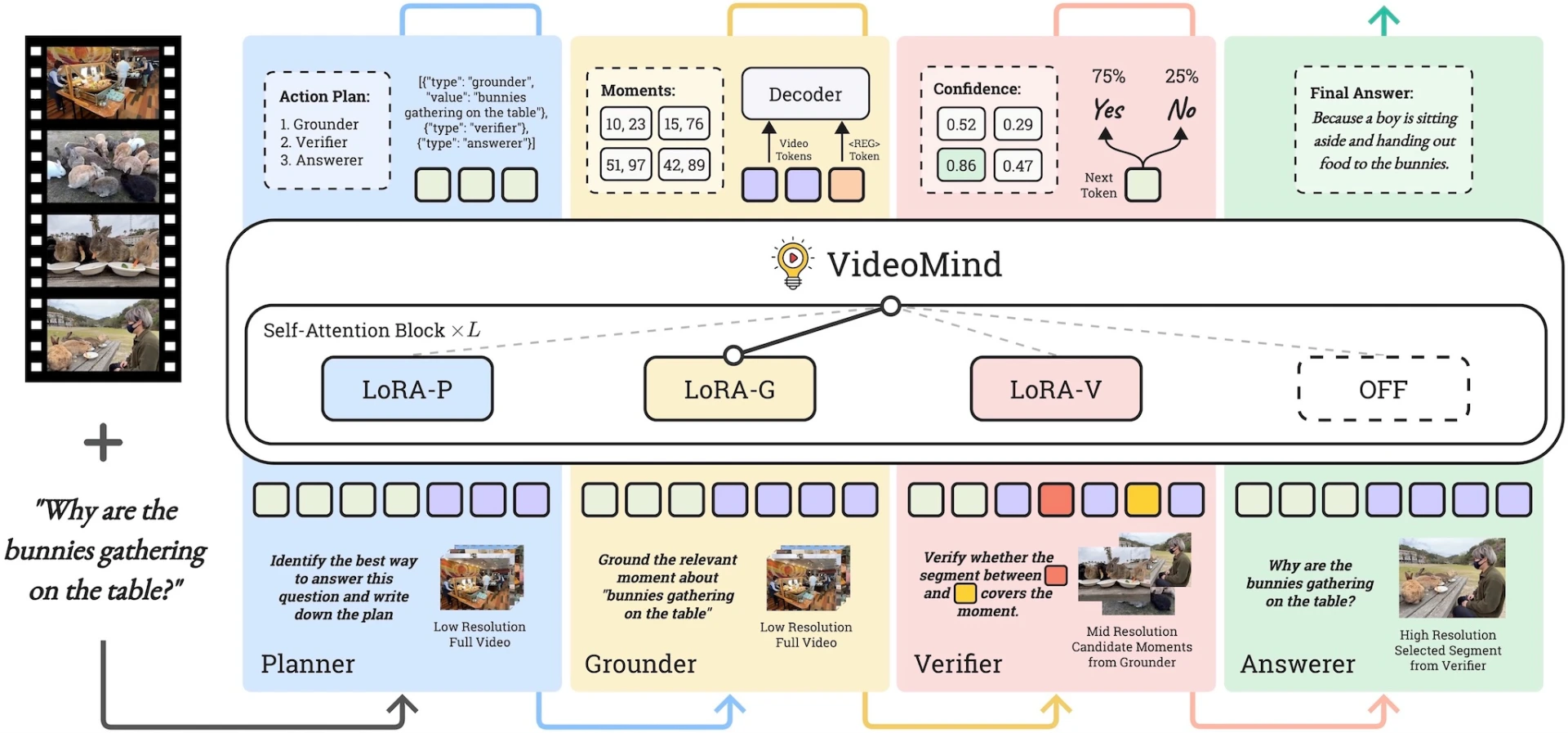

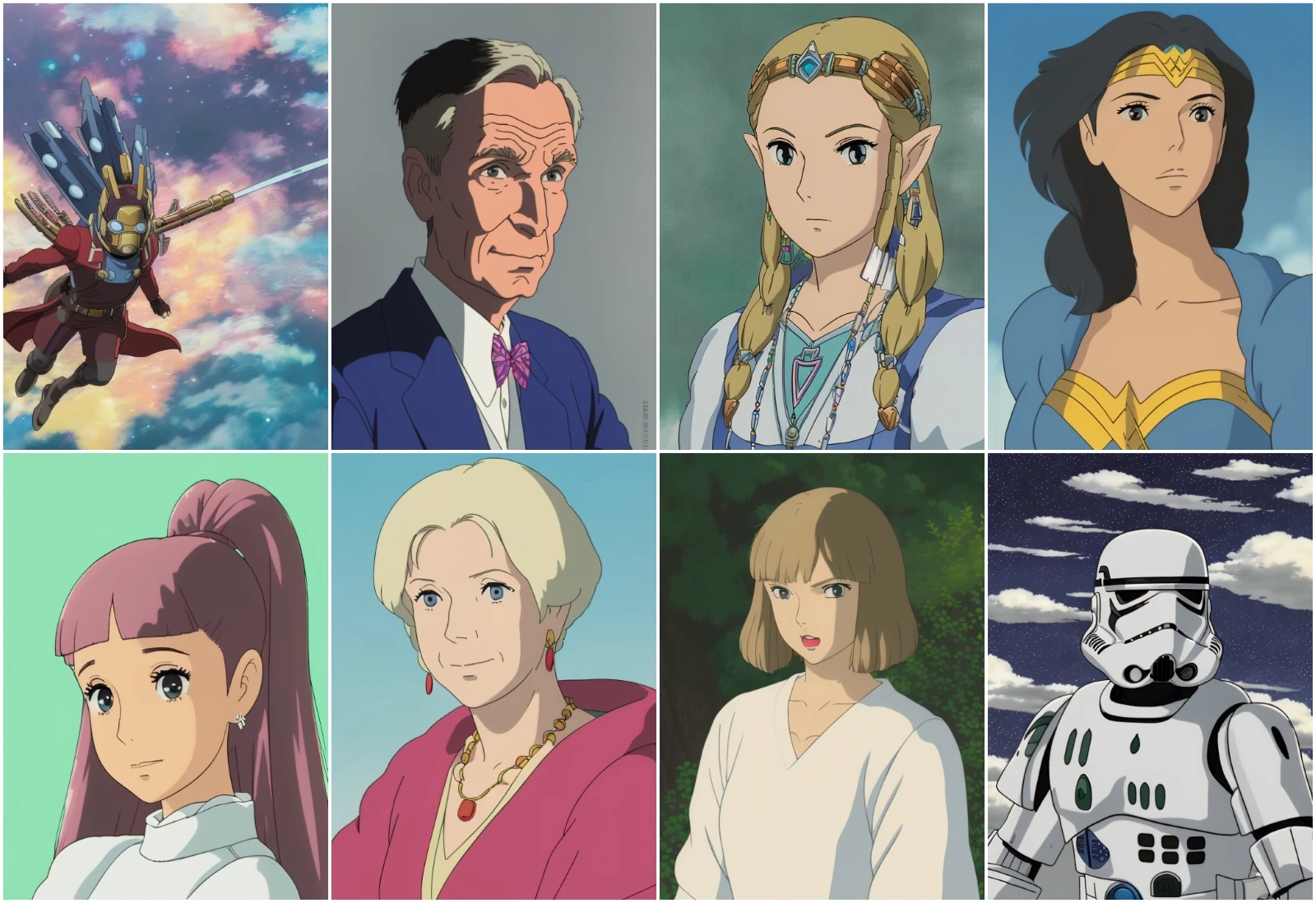

Ghibli-Diffusion是一个基于Stable Diffusion模型微调的文本到图像生成模型,专门用于生成具有吉卜力工作室(Studio Ghibli)风格的动画图像。这个模型由ai艺术家 nitrosocke 开发,训练数据来源于吉卜力工作室的现代动画电影。

Ghibli-Diffusion核心功能

文本到图像生成:用户可以通过输入文本提示词(如“ghibli style”)来生成具有吉卜力风格的图像。

图像到图像转换:用户可以上传现有图片,并将其转换为吉卜力风格的图像。

支持多种场景和对象:模型能够生成各种场景(如海滩、冰原、北极光等)和特定对象(如风暴兵、大众甲壳虫汽车等)。

Ghibli-Diffusion技术特点

扩散模型技术:基于扩散模型的正向和反向过程,逐步从噪声中重建出清晰的图像。

训练方法:采用 dreambooth 训练方法,结合先验保留损失(prior-preservation loss)和文本编码器训练标志,确保生成图像的高质量。

性能优化:最新版本在保持吉卜力风格的基础上,引入更多细节和个性化元素,生成速度更快。

Ghibli-Diffusion使用场景

创意设计:艺术家和设计师可以快速生成概念艺术、壁纸、海报等。

故事创作:帮助创作者将想象中的场景和角色转化为视觉艺术。

个性化内容:用户可以将自己的照片转换为吉卜力风格,用于社交媒体或个人艺术项目。

Ghibli-Diffusion使用教程

文本提示:在提示词中加入“ghibli style”,描述你想要生成的图像内容。

调整参数:根据需要调整采样器、CFG scale和步数等设置,以优化生成效果。

负提示词:使用负提示词排除不希望出现的元素,提高生成图像的质量。

优势与局限性

优势:

高质量的吉卜力风格图像。

快速生成,平均生成一张图像仅需5秒。

灵活性高,支持多种创作需求。

局限性:

生成的图像可能在某些复杂场景下不够完美。

对计算资源要求较高,需要较强的GPU支持。

示例代码

from diffusers import StableDiffusionPipeline

import torch

model_id = "nitrosocke/Ghibli-Diffusion"

pipe = StableDiffusionPipeline.from_pretrained(model_id, torch_dtype=torch.float16)

pipe = pipe.to("cuda")

prompt = "ghibli style magical princess with golden hair"

image = pipe(prompt).images[0]

image.save("./magical_princess.png")huggingface演示:https://huggingface.co/nitrosocke/Ghibli-Diffusion

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统