VideoMind:集视频自动化生产、长视频推理以及视频摘要等功能于一体的视频AI工具。

VideoMind是什么?

VideoMind 是一款集视频ai模型自动化生产、长视频推理以及视频摘要等功能于一体的视频AI工具。它基于流程化操作,自动化程度高,内置海量数据,可快速训练高质量模型。同时,通过链式 LoRA 策略实现长视频推理,精准定位并生成答案。此外,还能一键生成视频摘要,帮助用户快速提取关键信息,提升视频内容处理效率。

VideoMind功能特征

功能全面:集成了从创建模型到发布模型的全部功能,包括新建模型、创建标签、上传数据、标注数据、训练模型、评估校验、发布模型等7个环节。

数据丰富:集成了高达百万小时的标注数据,内置海量主题标签和实体标签。用户创建标签时如果成功映射内置标签,将不再需要针对此标签上传数据以及标注数据。

生产高效:一方面自动化生产流程降低了技术门槛,为客户省去了开发时间;另一方面内置的预训练AI网络结构和参数,让客户能够快速训练模型和迭代模型。

模型质量高:得益于百度在AI领域多年的积累,VideoMind生产的模型具备出色的模型效果,能支持企业垂类视频及图像内容分析需求。

部署灵活:训练完成的模型支持部署到公有云、私有云、嵌入式设备等,之后客户通过API的方式就可以调用。

一键生成摘要:可一键生成社交帖文的视频摘要、翻译和格式化。

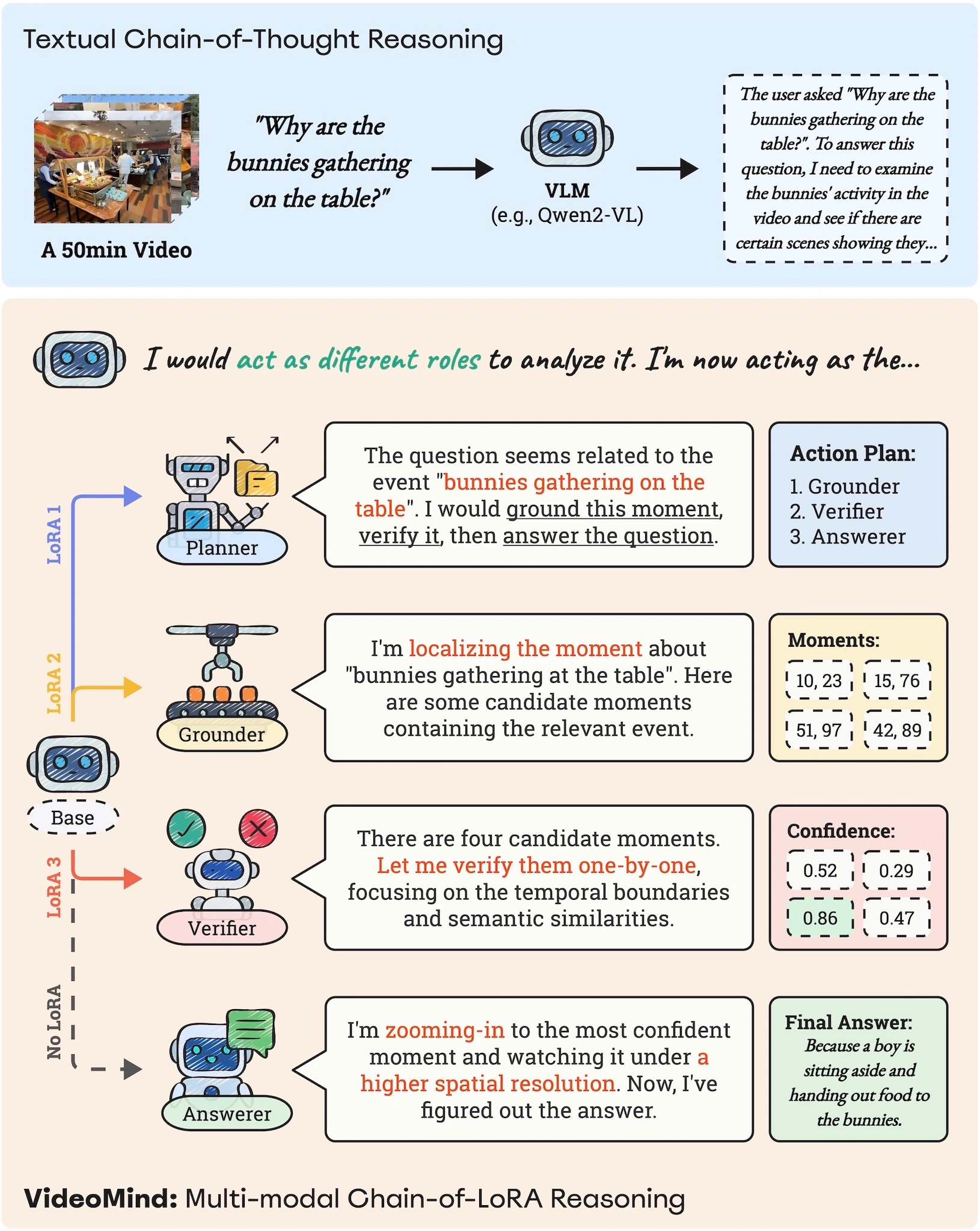

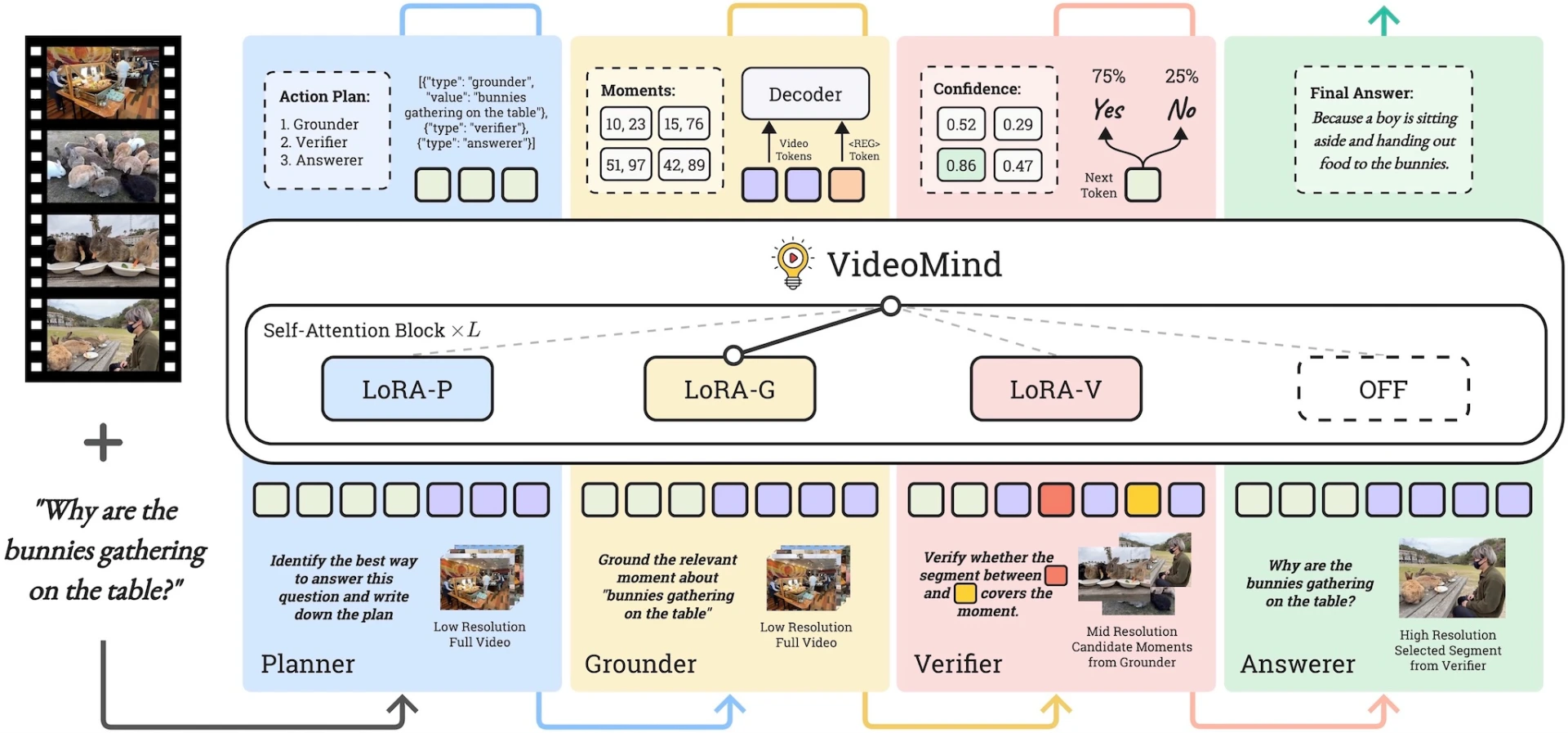

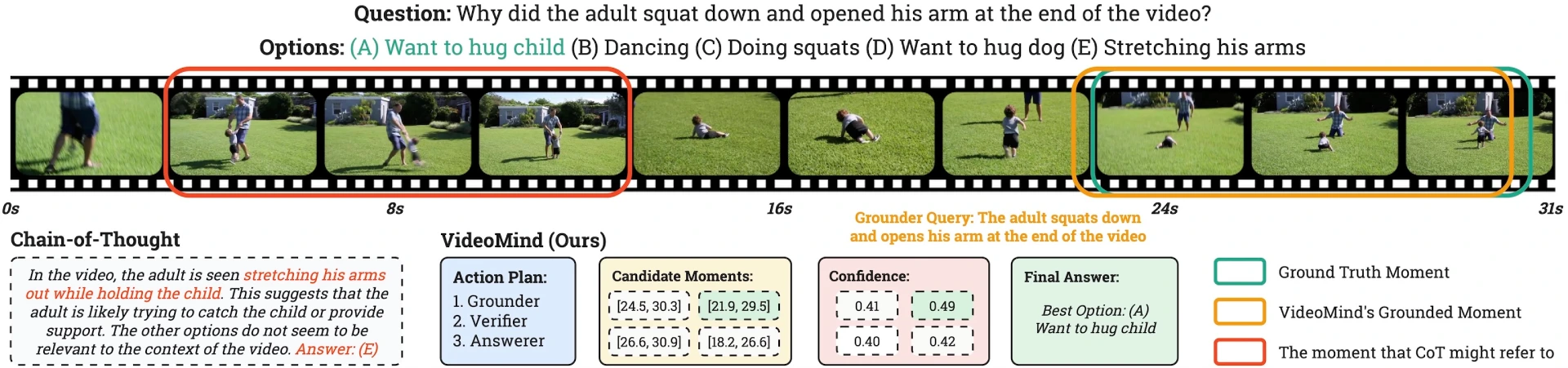

长视频推理能力:通过基于角色的工作流(包括规划者、定位者、验证者和回答者)和链式LoRA策略,实现对长视频的精确时间定位和推理,能够高效地处理复杂的视频理解任务。

快速提取关键信息:能够帮助用户快速准确地分析和总结YouTube视频的关键信息,节省时间和精力。

长视频推理的Chain-of-LoRA 代理

基于角色的工作流:定义了四种角色相互配合来实现长视频推理,分别是planner、grounder、verifier、answerer。

规划者(Planner):负责根据查询动态协调其他角色的调用顺序。

定位者(Grounder):负责根据文本查询精确定位视频中的相关时刻。

验证者(Verifier):负责验证定位者结果的准确性。

回答者(Answerer):负责生成最终的自然语言回答。

链式lora策略:以一个视觉-语言模型为基础,在推理时动态激活角色特定的 LoRA 适配器,高效地整合上述角色。

性能出色:在多个公共基准测试中表现出色,包括细节性视频问答任务、视频时间定位任务、通用性视频问答任务等。

VideoMind应用场景

教育领域:学生可以快速获取课程视频的重点内容,辅助学习和复习。

商业分析:企业可以对市场调研视频进行摘要,快速获取行业动态和竞争对手信息。

内容创作:视频创作者可以提炼出自己视频中的精华,制作宣传材料或社交媒体内容。

娱乐消费:用户在观看长视频时,可以快速了解视频的主要内容,帮助决定是否观看完整视频。

社交媒体:在短视频平台,用户可以提取视频中的亮点,制作吸引人的短视频内容。

相关链接

项目主页:https://videomind.github.io/

Github地址:https://github.com/yeliudev/VideoMind

Demo:https://huggingface.co/spaces/yeliudev/VideoMind-2B

论文:https://arxiv.org/abs/2503.13444

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统