DiffPortrait360:一种能够从单张人物肖像图像生成完整一致的360度头部视图的方法

DiffPortrait360是什么?

在游戏、电影和动画制作中,CG角色是内容创作的核心,需要在真实感和风格化之间找到平衡。以往的多视图立体系统和3D扫描仪常用于创建逼真的人类角色,但风格化角色仍需从头开始建模。而DiffPortrait360的出现,为高效生成风格化角色提供了一种新的思路。

DiffPortrait360是一种3D头部视图生成技术,它能够从单张人物肖像照片中生成360度的全方位头部图像。这项技术通过结合预训练的潜在扩散模型和多个辅助模块,实现了高质量、风格化的3D头部视图合成。DiffPortrait360支持多种复杂输入,如不同发型、姿态和面部表情,生成的模型可以广泛应用于沉浸式远程交互、个性化内容创作以及游戏和动画制作中。

方法原理

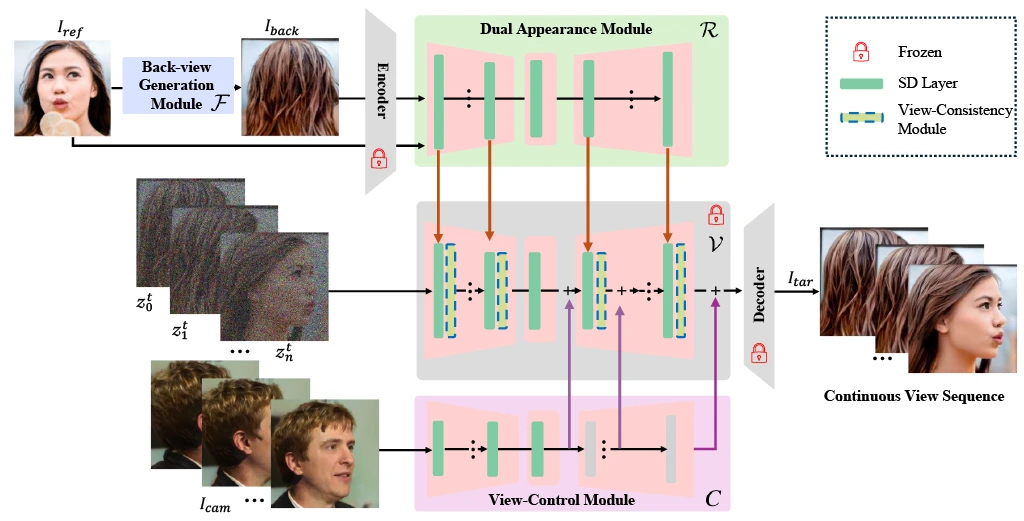

架构:DiffPortrait360以预训练的潜在扩散模型(LDM)作为渲染骨干网络,并引入了三个辅助可训练模块,分别用于控制双外观R、相机控制C和具有视图一致性的U-Nets。其中,R从正面和背面图像中提取外观信息,C推导相机姿态并使用现成的3D GAN进行渲染。

关键创新:该方法基于DiffPortrait3D框架,加入了自定义的ControlNet用于生成后脑细节,以及双外观模块以确保全局前后一致性。通过在连续视图序列上进行训练并整合后视图参考图像,实现了稳健的局部连续视图合成。

训练策略:采用连续采样训练策略,以更好地保持相机轨迹的连续性,并增强帧之间连续性的注意力,以保持外观信息在旋转角度变化时不变。

优势与特点

应用广:能够生成人类、风格化以及拟人化形式的360度头部视图,比如配饰眼镜和帽子。

质量高:可以生成高质量的神经辐射场(NeRFs),用于实时自由视点渲染,在对象合成和360度头部生成方面优于现有的最先进方法。

鲁棒性强:能够处理各种复杂的输入,包括复杂发型、不同头部姿态、丰富的面部表情以及详细的元素如舌头等。

应用前景

沉浸式远程存在应用:通过生成高质量的360度头部视图,为用户提供真实的体验。

个性化内容创作:能够根据用户提供的单张肖像图像,快速生成具有不同视角的3D头部模型。

游戏和动画制作:可以高效地生成风格化的角色头部模型,提高游戏和动画制作的效率和质量。

Github地址:https://github.com/FreedomGu/DiffPortrait360

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统