DreamActor-M1:字节跳动推出的一张人物照片替换到一段动作视频里的框架

DreamActor-M1是什么?

DreamActor-M1是字节跳动推出的一款基于扩散变换器(DiT)的人类图像动画框架,类似Runway的Act one,给定一张参考图像, DreamActor - M1可以模仿从视频中捕捉到的人类行为,制作多个尺度(从肖像到全身动画)的高度表现力和逼真的视频,也解决了其他框架表情和动作做得不够细腻,长视频容易细节会对不上,穿帮的问题,支持各种动作风格,表现均优于 Act-One、Animate Everyone 和 SkyReels-A1。

DreamActor-M1核心功能

静态照片转动态影像:通过结合一张静态照片和一段参考动作视频,将照片中的人物无缝替换到视频场景中,生成表情细腻、动作自然且画质高清的动态影像。

精细控制:采用混合引导机制,结合隐式面部表示、3D头部球体和3D身体骨架等控制信号,实现对人物面部表情和身体动作的精准控制。

灵活的运动转移:支持仅传递部分运动,例如面部表情和头部运动。

面部动画支持:可扩展至音频驱动的面部动画,实现多语言的口型同步。

形状感知动画:通过骨骼长度调整技术,实现形状适应的动画生成。

多样化风格支持:对各种角色和运动风格具有鲁棒性。

多种视角支持:能在不同的头部姿态下生成动画结果。

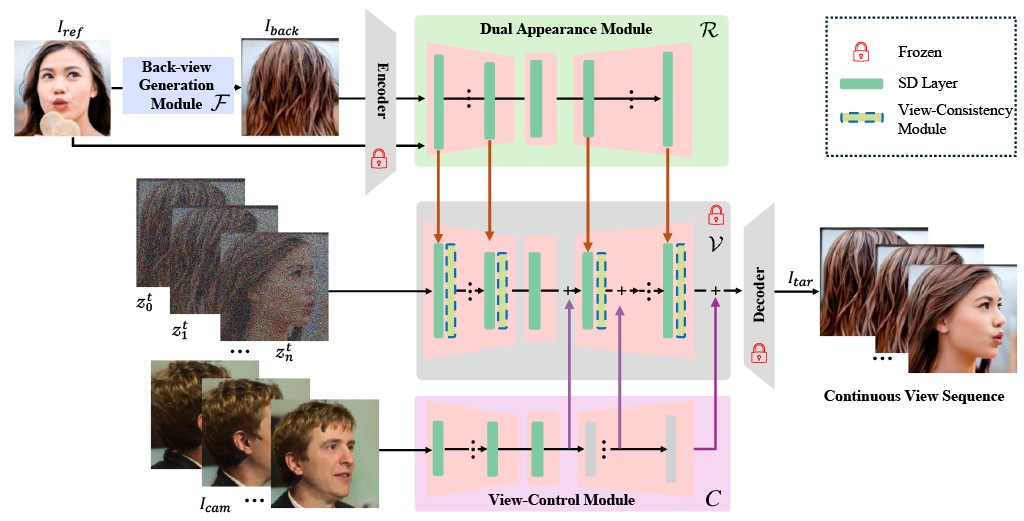

DreamActor-M1技术原理

混合引导机制:结合隐式面部表示、3D头部球体和3D身体骨架等控制信号,确保生成的动画在细节上高度逼真,同时保持整体的协调性和流畅性。

多尺度适应性:通过逐步训练策略,能处理各种身体姿势和不同分辨率的图像,支持从肖像到全身视图的转换。

长期时间一致性:通过整合连续帧的运动模式和视觉参考,确保在复杂动作中未观察区域的时间一致性。

面部动画与语音支持:支持音频驱动的面部动画,能实现多语言的口型同步。

DreamActor-M1应用场景

影视制作:用于生成虚拟角色的动画。

广告行业:创建动态的人物广告。

视频游戏:生成游戏中的角色动画。

虚拟主播:为虚拟主播提供更自然、更逼真的动画效果。

教育与培训:创建动态的教学视频,使人物能够进行各种动作和表情。

社交媒体:生成个性化的动态头像或短视频。

项目链接

项目官网:https://grisoon.github.io/DreamActor-M1/

arXiv技术论文:https://arxiv.org/pdf/2504.01724

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统