HairFastGan:一种虚拟发型试戴框架,能够实现接近实时的发型转移

HairFastGAN 是什么?

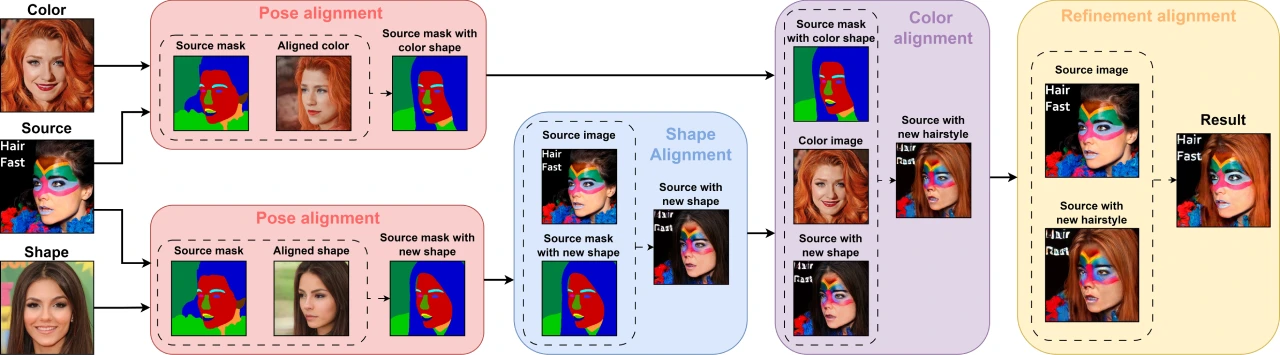

HairFastGAN 是一种虚拟发型试戴框架,能够在高分辨率下实现接近实时的发型转移。它通过在 StyleGAN 的 FS 隐空间中操作,结合增强的修复方法和改进的编码器,解决了复杂姿态下的发型对齐、颜色转移和细节修复问题,特别是在复杂发型和姿态差异较大的场景更出色。

HairFastGAN 核心特点

高效性:与传统的基于优化过程的发型转移方法相比,HairFastGAN 采用编码器架构,在保证高分辨率输出的同时,能够实现接近实时的性能。在最复杂的发型形状和颜色转移场景中,该方法在 Nvidia V100 GPU 上的运行时间不到一秒。

高质量重建:HairFastGAN框架通过在 StyleGAN 的 FS 隐空间中操作、增强的修复方法以及改进的编码器,实现了更好的对齐、颜色转移和后处理,从而在随机发型转移和重建原始发型时表现出色。

姿态适应性:传统的发型转移方法在源姿态与目标姿态差异较大时表现不佳,而 HairFastGAN 通过考虑姿态信息,能够有效地处理这种差异。

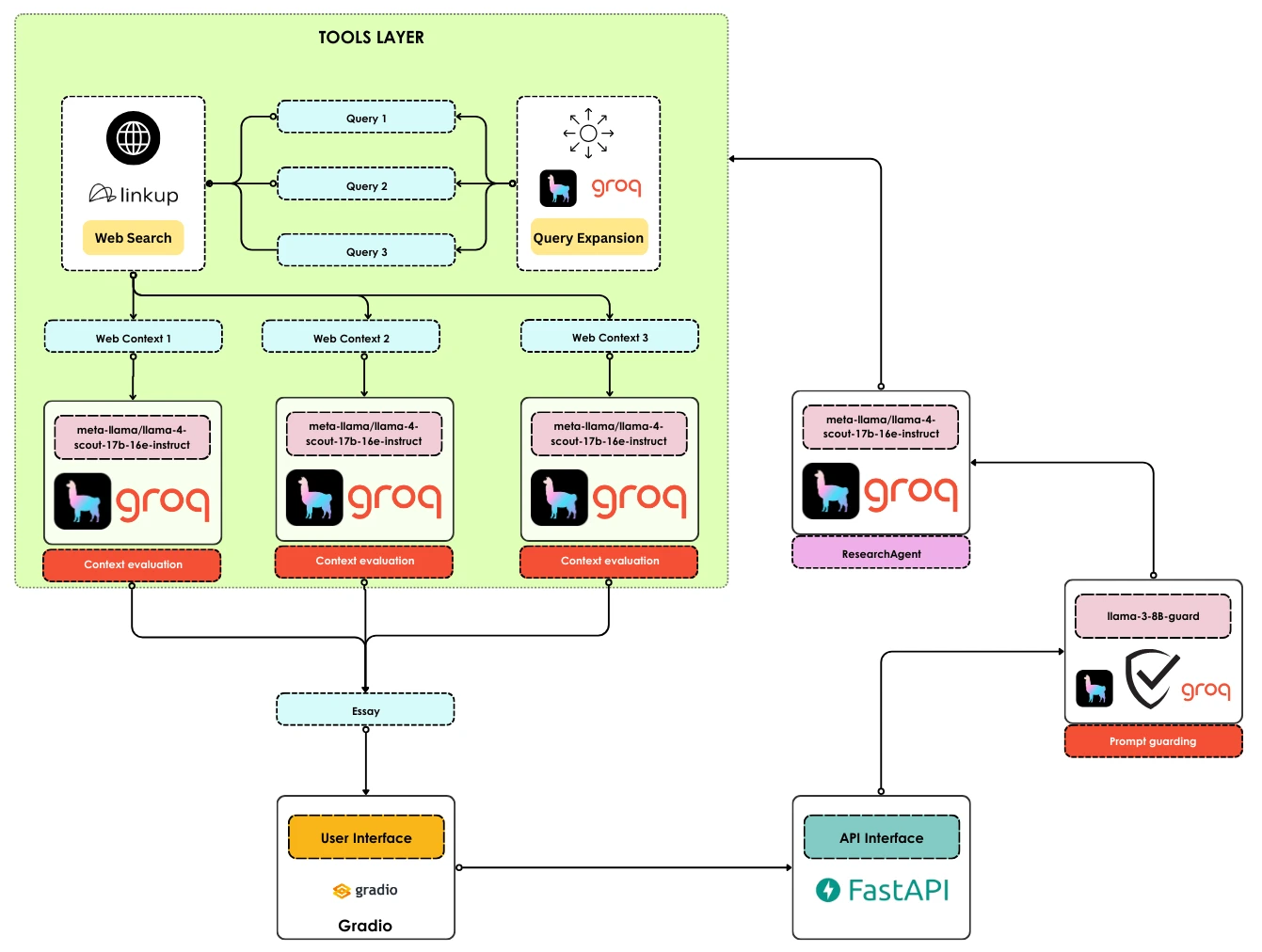

HairFastGAN 方法

嵌入(Embedding):将输入图像和参考图像嵌入到 StyleGAN 的 FS 隐空间中,同时获取分割掩码。

对齐(Alignment):通过形状模块将参考图像中的发型形状转移到目标图像上。

混合(Blending):通过编辑源图像的 S 空间,将参考图像中的发色转移到目标图像上。

后处理(Post-Processing):恢复原始图像中丢失的细节,确保面部身份的保留和结果的真实性。

HairFastGAN 应用场景

美发行业:虚拟发型试戴,帮助客户快速预览不同发型效果,提升美发设计体验。

时尚与美妆:用于时尚杂志、广告设计,以及个人形象设计,快速生成多种发型方案。

娱乐与游戏:在游戏中定制角色发型,或在社交媒体中作为滤镜实时试用。

医疗康复:帮助植发患者预览术后效果,或为脱发患者提供心理康复辅助。

HairFastGAN使用方法

1. 安装依赖

首先,确保你的环境已安装 Python 和必要的依赖库。可以通过以下命令安装:

pip install torch torchvision pip install git+https://github.com/NVlabs/stylegan2-ada-pytorch.git

2. 克隆项目代码

从 GitHub 克隆 HairFastGAN 的代码:

git clone https://github.com/AIRI-Institute/HairFastGAN.git cd HairFastGAN

3. 下载预训练模型

从 Hugging Face 或项目提供的链接下载预训练模型文件,并将其放置到指定目录(如 models/)。

4. 准备输入图像

输入照片:需要一张包含人脸的高清照片。

参考照片:包含目标发型的参考照片。

确保输入照片和参考照片的分辨率和格式符合要求。

5. 运行代码

运行以下命令进行发型转移:

python run.py --input <input_image_path> --ref <reference_image_path> --model <model_path>

<input_image_path>:输入照片的路径。

<reference_image_path>:参考照片的路径。

<model_path>:预训练模型的路径。

6. 查看结果

运行完成后,生成的发型转移结果将保存到指定的输出目录(如 output/)。

相关链接

GitHub 项目:https://github.com/AIRI-Institute/HairFastGAN

项目主页:https://airi-institute.github.io/HairFastGAN/

体验试用:https://huggingface.co/spaces/AIRI-Institute/HairFastGAN

Hugging Face 模型:https://huggingface.co/AIRI-Institute/HairFastGAN

论文:https://arxiv.org/abs/2404.01094

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统