卷姬:OpenBMB开源社区推出的AI Agent代码工具

卷姬是什么?

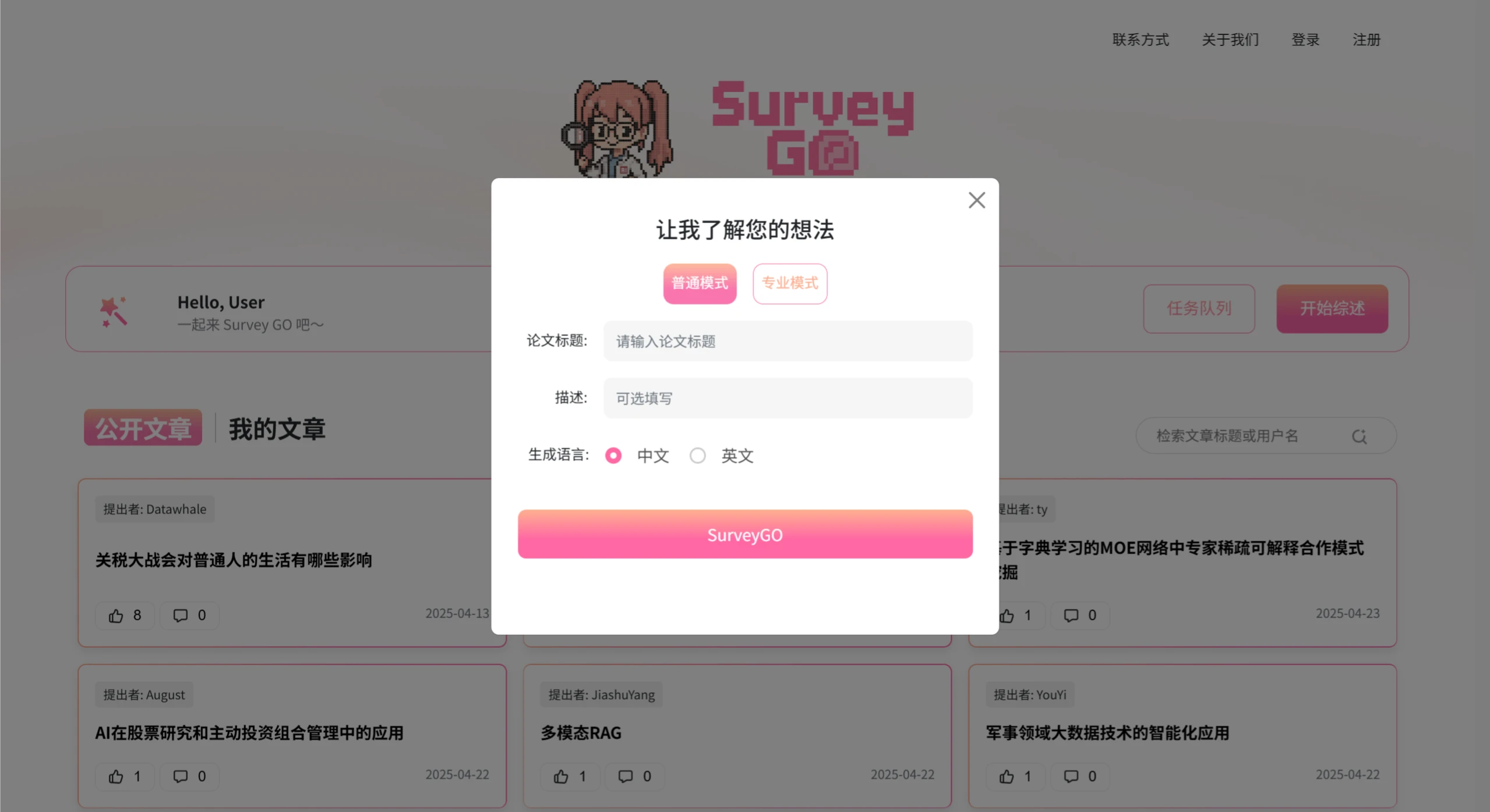

「卷姬」是OpenBMB 开源社区最近推出的代码ai Agent 工具,专门用于高效提取有价值的内容。用户只需在官网输入需求,就能快速生成一份综述报告。

「卷姬」有两种模式可供选择:普通模式会输出标题和关键词;专业模式则更灵活,用户可以自定义素材来源,比如选择在线检索或上传文件。

相比其他工具,「卷姬」在逻辑严谨性和学术性上表现突出,特别适合做深度分析。它生成的文章结构清晰,导言部分深入浅出,结尾分析全面细致,论述详尽且有理有据。

「卷姬」背后的技术是 LLMxMapReduce-V2,由多个团队联合研发,专门用于优化文献聚合和利用。目前,「卷姬」已经上线,相关论文和开源内容都可以找到。

卷姬核心功能

文献筛选与结构化输出:针对用户输入的关键词,自动从论文库中筛选高质量文献,并生成包含核心逻辑、方法论及研究空白的结构化框架。

动态知识图谱构建:通过分析文献间的引用关系与概念关联,生成可视化的研究领域演进图谱,帮助用户快速定位学术热点与趋势。

多语言支持与领域适配:支持中英文混合输入,并可根据计算机科学、生物医学等不同学科调整分析模型,提升领域适配性。

卷姬技术原理

「卷姬」基于OpenBMB的模型生态开发,结合卷积算法与信息熵优化技术,能够快速解析海量文献,生成逻辑清晰、高信息密度的综述报告。其背后是LLMxMapReduce - V2长文本整合生成技术,由AI9Star、OpenBMB和清华大学团队联合研发,核心在于借助文本卷积算法聚合参考文献,结合信息熵驱动的随机卷积测试时缩放方法,高效处理超长输入,提升文章质量。

卷姬使用教程

打开网址 https://surveygo.thunlp.org/,点击【开始综述】。

选择普通模式或专业模式提交需求。

普通模式:输出标题和关键词描述,提交并等待生成。

专业模式:可进一步自定义素材来源,选择「在线检索」或「上传文件」。为保护用户隐私,基于上传文件所生成的文章及上传的文件,可设置不公开。

再次登录网址,即可获取生成的综述报告。

性能表现

速度与质量:在清华大学团队的测试案例中,「卷姬」仅用3分钟便完成了对200篇量子计算领域论文的综述生成,输出内容长达2.8万字,且逻辑连贯性获导师组认可。

横评优势:团队开展横评,让「卷姬」与OpenAI - DeepResearch等模型就《关税大战对普通人生活的影响》撰写综述。从结构、内容、观点和引用维度评估,「卷姬」表现优异。其生成文章目录层次清晰,内容分析深入,观点有理有据,引用精准,综合实力超过其他模型。

相关链接

体验链接:https://surveygo.thunlp.org/

论文链接:https://arxiv.org/abs/2504.05732

开源链接:https://github.com/thunlp/LLMxMapReduce/tree/main

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统