DeepSeek Coder

DeepSeek Coder简介

DeepSeek Coder是由中国人工智能公司深度求索(DeepSeek)推出的开源代码生成大模型系列,通过深度学习技术提升代码生成和理解能力,提升开发者的编程效率,并在多项基准测试中达到或超越主流闭源模型的性能。

一、模型架构与核心技术

混合专家架构(MoE)

DeepSeek Coder V2采用MoE架构,总参数达236B,激活参数21B,通过动态选择专家网络提升任务适配性。其训练数据覆盖338种编程语言(从V1的86种扩展而来),并支持128K上下文窗口,可处理复杂代码仓库和长文本任务。

创新训练方法

Fill-In-Middle(FIM):通过随机分割代码为前缀(Prefix)、中间(Middle)和后缀(Suffix),训练模型填补中间缺失部分,增强代码补全能力。

Repo-Level预训练:基于代码仓库的依赖关系构建数据集,利用拓扑排序处理跨文件依赖,提升项目级代码生成能力。

强化学习优化

采用GRPO(Group Relative Policy Optimization)算法对齐人类偏好,结合编译器反馈和测试用例优化代码正确性。

二、性能表现与基准测试

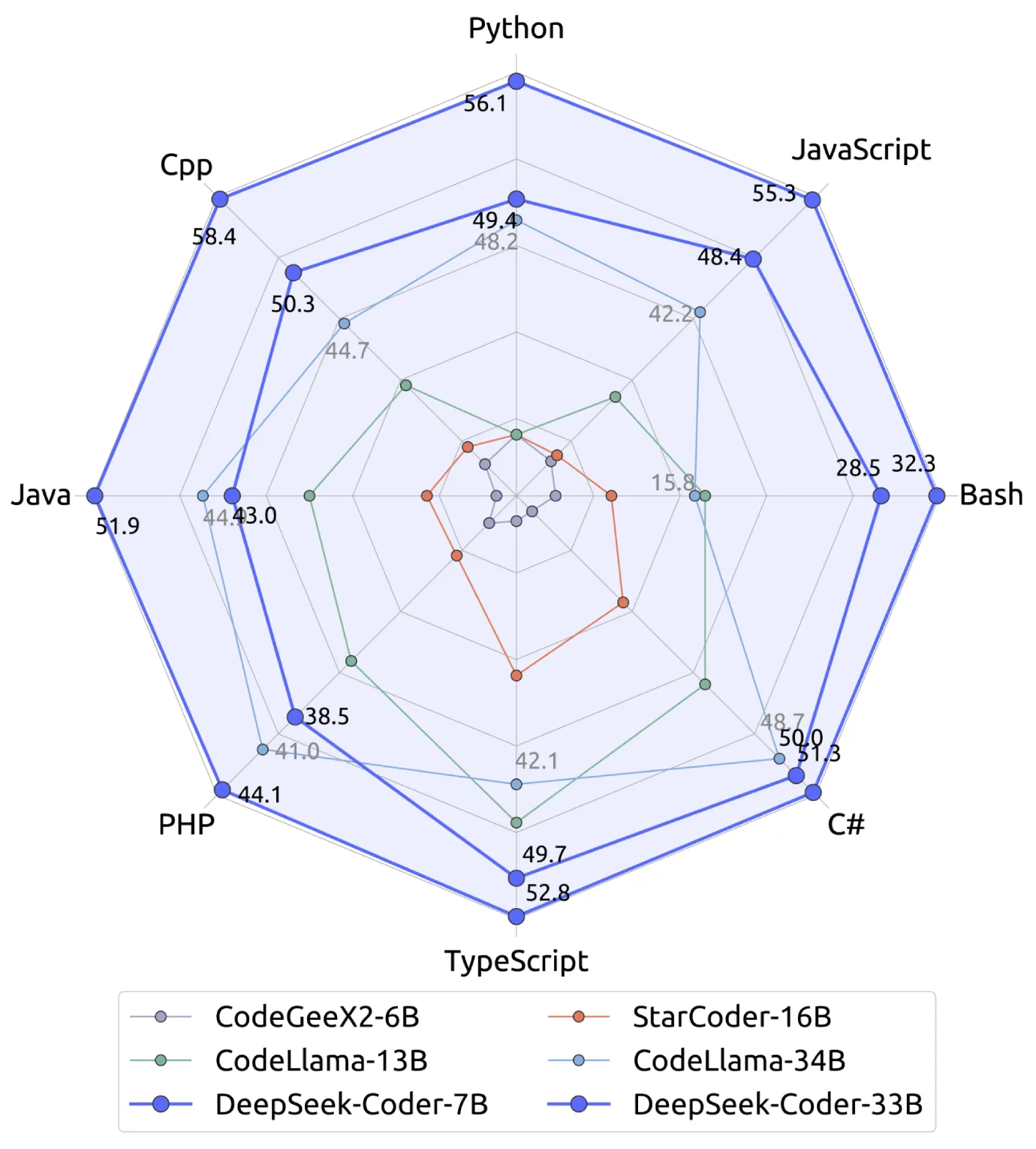

代码生成能力

在HumanEval基准测试中,DeepSeek Coder V2的准确率达90.2%,超过GPT-4-Turbo和Claude 3 Opus8。

在SWEBench(复杂代码任务测试)中,首次实现开源模型得分超过10%。

支持多语言生成,覆盖Python、Java、Rust等338种语言,生成速度比GPT-4快20%。

数学与推理能力

在MATH、aiME等数学竞赛级基准测试中,性能与GPT-4o、Gemini 1.5 Pro相当。

通过链式推理(Chain-of-Thought,COT)显著提升复杂问题解决能力。

通用语言处理

在MMLU(多任务语言理解)测试中得分79.2%,保持与通用模型(如DeepSeek-V2)相当的通用能力。

三、开发者生态与应用场景

开源与低成本

模型、代码及技术报告完全开源(MIT协议),支持免费商用和二次开发。

API定价极具竞争力,输入成本仅0.27美元/百万tokens(缓存命中时低至0.07美元),远低于GPT-4的18美元。

集成与部署

提供Hugging Face预训练模型和本地私有化部署方案,支持单机880G显存部署或单卡40G轻量版(V2-Lite)。

集成开发工具链(如vLLM框架),优化稀疏注意力机制,降低内存占用并提升推理速度。

应用案例

自动化代码审查:识别代码漏洞并提出优化建议,加速开发周期。

API构建:自动生成RESTful服务、GraphQL查询等,减少模板代码编写。

机器学习项目:生成数据管道和算法代码,支持端到端AI开发。

DeepSeek Coder 可以广泛应用于软件开发、数据分析、自动化测试等领域。它不仅能够生成代码,还能回答与编程相关的问题,帮助开发者提高工作效率。

DeepSeek Coder通过技术创新(如MoE架构、FIM训练)和开源生态,重新定义了代码生成模型的性能边界。其高性价比、多语言支持和项目级代码处理能力,使其成为开发者提升效率的核心工具,同时推动全球AI开源社区的协作与进步。随着后续多模态和更大规模模型的推出,DeepSeek或将成为AGI时代代码生成领域的标杆。

Github代码库:https://github.com/deepseek-ai/DeepSeek-Coder

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统