Loopy AI

Loopy AI简介

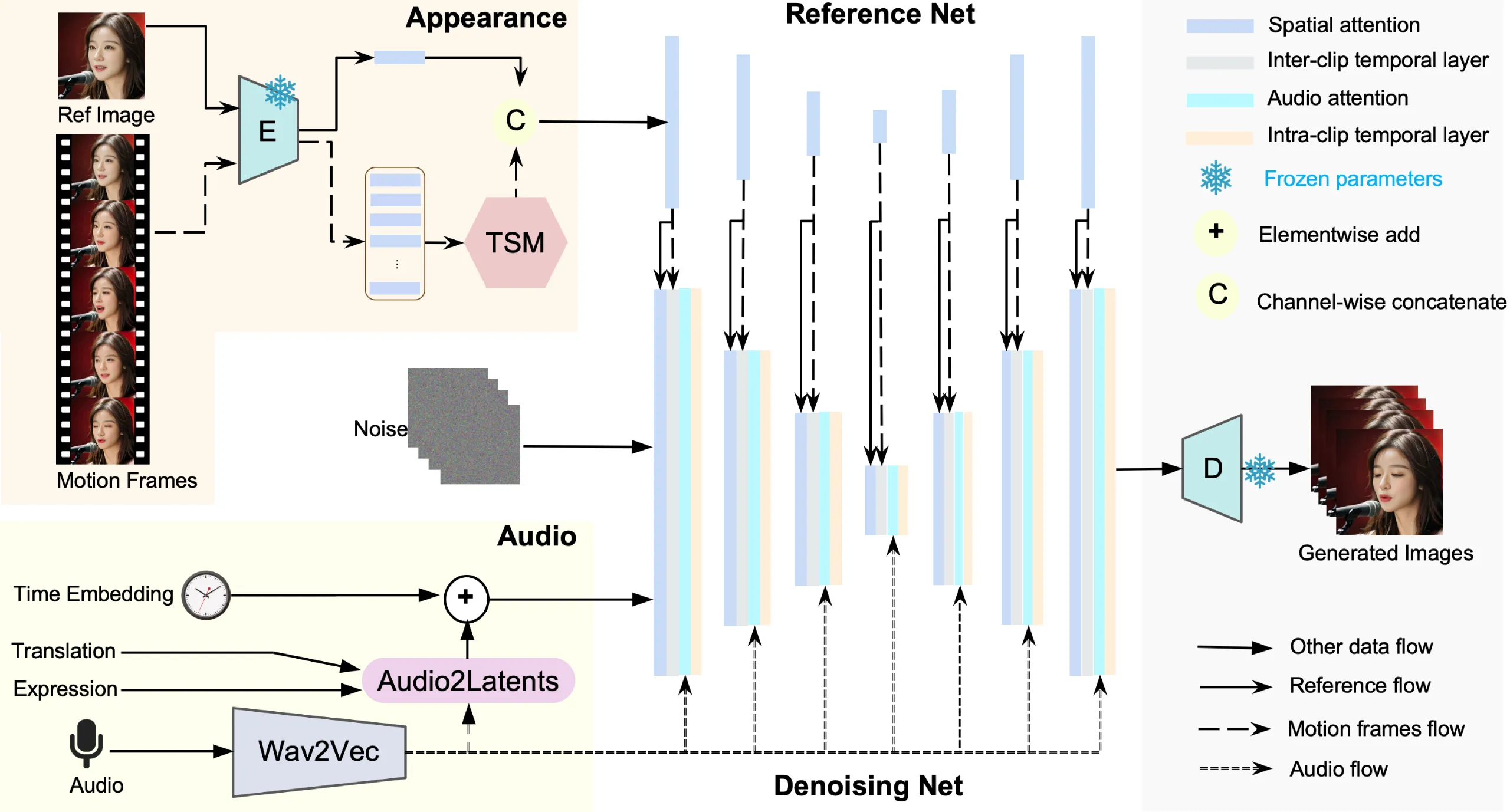

Loopy ai是由字节跳动和浙江大学联合开发的音频驱动的AI视频生成模型,能够将静态图像转化为动态视频,实现音频与面部表情、头部动作的完美同步,它通过音频生成生动的面部表情和动作细节,包括微表情、眉毛和眼睛的细微变化,以及自然的头部动作。

Loopy A主要功能:

音频驱动的视频生成:Loopy能够根据输入的音频文件,自动生成与之同步的动态视频。这一过程不仅限于简单的口型同步,还包括面部表情和头部动作的自然变化。

高精度的面部表情捕捉:该模型能够捕捉细微的面部微表情和情感变化,例如眉毛和眼睛的细微变化,提升了视频的真实感。

多样化的应用场景:Loopy的应用范围广泛,包括动画制作、虚拟主播、在线教育、社交媒体内容创作等。它可以帮助内容创作者在制作视频时,减少手动调整的工作量。

实时互动:通过结合AI语言模型与视觉模型,Loopy能够在角色说话时自动运用语气、情感和表情,使得数字人与观众之间的互动更加自然。

支持多种风格:Loopy支持多种视觉和音频风格,能够根据不同的音频输入生成不同效果的视频。

长期运动信息捕捉:Loopy采用了独特的长期运动信息捕捉模块,能够学习和利用数据中的长期运动模式,从而生成更自然的动态效果。这一技术使得Loopy在处理复杂场景时表现出色,能够生成高质量、高真实度的结果。

多样化的动作生成:该模型不仅能够生成口型同步的动作,还能根据不同的音频输入生成多样化的动作效果,包括非语言动作(如叹息、情绪驱动的眉毛和眼睛运动)以及自然的头部运动。

适应性强:Loopy在处理不同风格的输入图像时表现良好,包括古风画像、油画风格和侧面肖像等。

应用于虚拟现实和增强现实:Loopy的技术可以广泛应用于虚拟现实(VR)和增强现实(AR)场景中,为用户提供更加沉浸式的体验。

Loopy AI技术创新点:

长期运动依赖性处理:Loopy解决了现有技术在处理音频驱动视频时面临的长期运动依赖性问题,确保生成的视频不仅在短期内自然,而且在较长的时间跨度内也能保持动作的连贯性和真实性。

智能表情与动作匹配:通过深度学习,Loopy能够分析音频中的情感和语调,智能匹配相应的面部表情和身体动作。

论文与演示:Loopy的研发团队不仅发布了技术论文,还提供了大量演示视频,展示了其技术的先进性和实用性。

Loopy AI应用场景

社交媒体和娱乐:为静态照片添加动态效果,增加互动性和娱乐性。

电影和视频制作:创造特效,让历史人物“复活”。

游戏开发:为游戏中的非玩家角色(NPC)生成更自然和逼真的面部表情和动作。

教育和培训:制作教育视频,模拟历史人物的演讲或重现科学实验过程。

广告和营销:创造吸引人的广告内容,提高广告的吸引力和记忆度。

Loopy AI使用:

用户可以通过即梦AI平台体验Loopy AI的对口型功能。即梦AI是字节跳动推出的一站式AI创作平台,提供AI图片创作、AI视频创作、AI图片编辑等功能。

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统