eeChat

eeChat简介

eeChat是什么?

eeChat是一个简洁易用的大模型本地部署工具,专注于数据安全、隐私保护和高效的ai对话体验。支持开源模型 DeepSeek-R1, DLlama 3, Phi-4, Mistral, Gemma 3 等模型的本地化部署,同时支持远程大模型API调用。

eeChat核心优势

数据安全与隐私保护

本地模型支持:直接在设备上运行 AI 模型,无需将数据发送到外部服务器。完全控制您的数据。

离线能力:初始设置完成后无需持续联网。

API自定义:可以连接到自己的AI模型API或第三方服务,完全控制数据流。

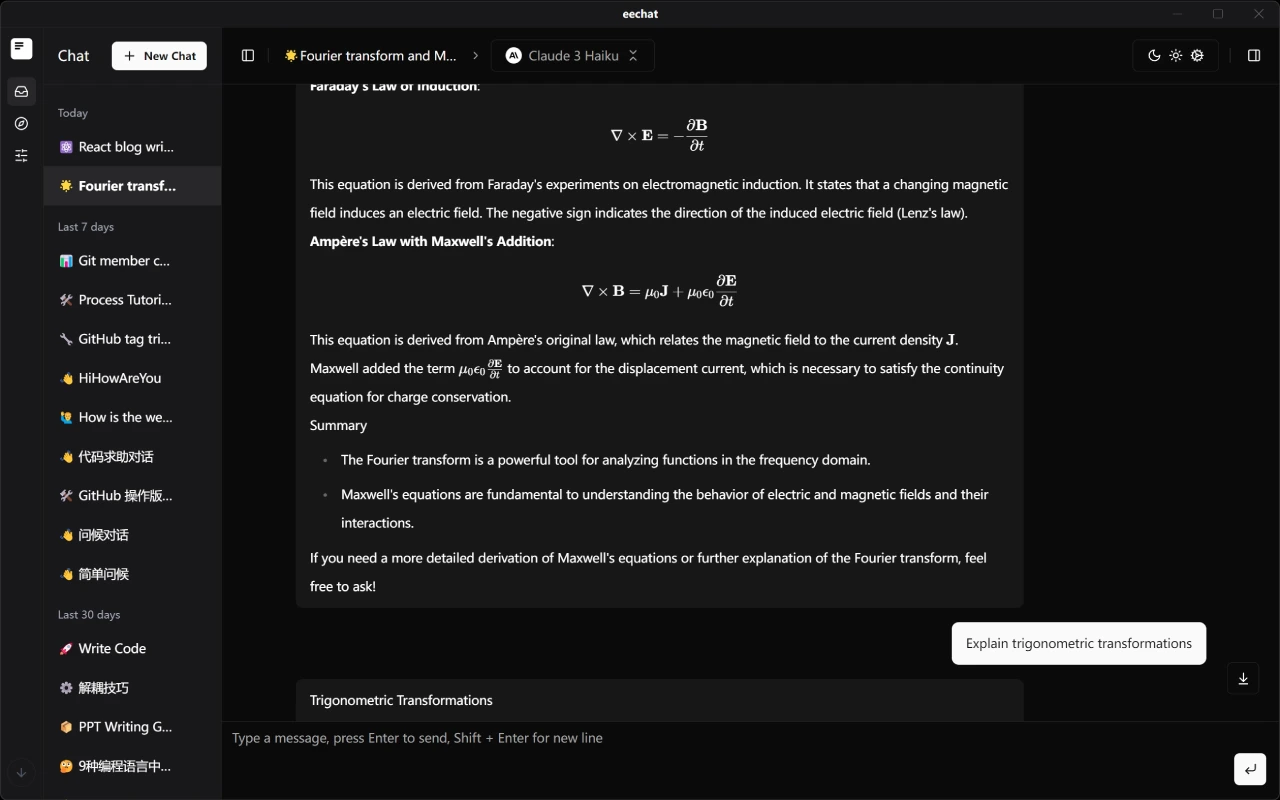

卓越的对话体验

多会话管理:轻松创建和管理多个独立对话。

历史记录跟踪:自动保存所有对话历史,方便回顾和继续。

完美支持Markdown:精确渲染Markdown格式,包括代码块、表格和数学公式。

智能代码高亮:自动检测并高亮多种编程语言的代码块。

数学公式渲染:通过 LaTeX 支持美观地呈现复杂数学方程和公式。

个性化选项

主题切换:内置浅色和深色主题,满足不同场景和偏好。

提示词管理:保存和管理常用提示词,提高对话效率。

模型参数调整:灵活调整温度、最大输出等参数,获得最佳响应。

强大的可扩展性

插件生态系统:支持功能扩展,满足特定场景需求。

自定义模型支持:配置和使用自定义的本地或远程AI模型。

eeChat主要功能

增强智能对话

上下文理解:AI在长对话中保持上下文连贯性。

多轮优化:增强复杂查询的交互体验。

知识库集成:连接自定义知识库,提供更准确的领域特定响应。

开发者友好

代码生成与解释:支持多种编程语言的优化代码生成能力。

API文档生成:帮助开发者快速生成API文档。

调试辅助:帮助识别代码问题并提供修复建议。

生产力工具

eeChat本地部署

系统要求

Windows 10/11 64位

macOS 10.15+

Linux (Ubuntu 18.04+, Debian 10+)

最小4GB内存

500MB可用磁盘空间

支持CUDA的GPU(可选)8GB+(Windows)

安装方法

下载预构建包:从发布页面下载适合您系统的安装包。

从源代码构建

# 克隆仓库 git clone https://github.com/Lucassssss/eechat.git cd eechat # 安装依赖 npm install # 以开发模式运行 npm run dev # 构建应用程序 npm run build

GitHub 仓库:https://github.com/Lucassssss/eechat

提交您的产品

提交您的产品  Ai应用

Ai应用 Ai资讯

Ai资讯 AI生图

AI生图 AI生视频

AI生视频 AI生PPT

AI生PPT AI数字人系统

AI数字人系统